Стереотипы как предмет стратегического анализа

Стереотипы. Они всегда верны, как бы ни морщила нос продвинутая публика. Они такая же внеморальная реальность, как запах навоза. Стереотипы - это те самые информационные объекты, о которых писал Талеб, объясняя "правило Линди": ожидаемая продолжительность их жизни прямо пропорциональна их возрасту - чем дольше они существуют, тем дольше будут существовать в будущем. Стереотипы - скрытый каркас социальных институтов, выдержавший испытание реальностью и потому длящийся в завтра. Таким образом, стереотипы - это надежная основа стратегии, поскольку они определяют ту часть будущего, которая в сценарном планировании называется детерминированной или неизбежной.

Стереотипы надо исследовать - так мы поймем их причины, и как они воздействуют на поведение людей. Анализируя прошлое стереотипа, мы достоверно предскажем ту часть будущего, которая релевантна для него.

Философ Дэниел Деннет советует задавать риторические вопросы и отвечать на них, чтобы осознать структуру социальной реальности. Это близко к тому, о чем говорю я, предлагая использовать стереотипы как предмет стратегического анализа. Риторические вопросы - это метод разборки самоочевидного на части, нащупывание институционального каркаса, вскрытие "как на самом деле все устроено". Стереотипы - это собственно самоочевидное, тайный каркас социальных институтов. В стратегическом менеджменте, исследуя значимые для бизнеса стереотипы методом риторических вопросов, выясняя их генезис, мы выполняем форсайт высокого качества и высокой ценности - определяем релевантное для компании прошлое, которое неизбежно сохранится в будущем.

Можно ли говорить об иерархии стереотипов или, точнее, об уровнях сложности в их системе? Да. Стереотипы общества, взятого в целом, включают в себя стереотипы присутствующих в нем отраслевых бизнес-экосистем. Те, в свою очередь, состоят из стереотипов, живущих в организациях – коллективных стейкхолдерах, составляющих отдельные бизнес-экосистемы. Наконец, последние складываются из стереотипов, относящихся к организационным функциональным ролям.

Примеры? На уровне социума: жители мегаполисов - нервные и постоянно спешат; все французы грубы; китайцы всегда пытаются скопировать западные технологии; в Сингапуре чистота - следствие строгих законов, а не морального выбора граждан. На уровне бизнес-экосистем: в морском транспорте старшие капитаны упрямы и не принимают новаторских подходов; игровая индустрия способствует развитию зависимостей и антисоциального поведения; “биг фарма” не может существовать без монополизации и непомерно высоких цен на жизненно важные препараты; в мире криптовалют все участники - анонимные мошенники, жаждущие быстрой наживы. На уровне организации: в биотехнологиях стартап - место с крайне высоким уровнем стресса; любая техническая компания в основном нанимает мужчин; благотворительные организации используют большую часть пожертвований на административные расходы, а не на целевые программы; в исслеовательских компаниях, где работают в основном женщины, прогресс невелик из-за склонности женщин к консервативным взглядам в науке. На уровне функциональной роли: системные администраторы - замкнутые и недружелюбные; все менеджеры проектов - педанты; все HR-менеджеры глухи к проблемам сотрудников; IT-аналитики всегда настаивают на создании сложных и излишне детализированных систем, вместо того чтобы стремиться к простоте и удобству пользователей.

Важно не смешивать стереотипы и поведение. Стереотипы - это дух, скрытый в букве кодексов, причина традиций. Поведение же - это материализация первых и вторых в деятельности людей. Обнаруженные и проанализированные в стратегических целях стереотипы не нужно исправлять. Социальный инжиниринг на любом уровне - зло для отдельного человека, даже если это peacemeal engineering Карла Поппера, философа прогресса и либерализма. Да и весьма долгое это дело. Уровень компании здесь не исключение. Когда цель - прибыль, лезть в чужую душу аморально и бесперспективно. Управляйте поведением сотрудников, это честнее, проще и имеет ROI. Ведь запах навоза - нравится или не нравится - всегда предшествует запаху утреннего кофе и тостов. А стереотипы используйте для выявления неизбежной, детерминированной части будущего и выработки стратегии под неё.

Ошибка как преимущество: новая роль человека в совете директоров

Искусственный интеллект (AI) и решения, основанные на данных (DDD), все глубже интегрируются в стратегическое управление организациями. Людей-стратегов пугает картина близкого будущего, в котором эти технологии превзойдут человеческие возможности, в первую очередь - в уменьшении количества ошибочных решений.

Но если отказаться от принципа, что ценность специалистов - стратегов в том числе - заключается в безошибочности выполнения ими работы, то можно представить, что конкурирующие с AI стратеги-люди постепенно и по большей части вынужденно сосредоточатся на том, что умеют делать лучше всего, а именно - на совершении ошибок в своих организационных ролях. Такая смена парадигмы, очевидно, способна постепенно переключить стратегическое управление в организациях с подхода, предполагающего минимизацию ошибок, на подход их намеренного генерирования.

В рамках такой парадигмы стратегам придется выйти за рамки попыток рационального реагирования на идеи, основанные на данных, которые обработал и положил перед ними на стол AI. Лживая метафора “DDD и AI - штаб, а человек - главнокомандующий” прекратит существование. У детерминизма, пусть он и объективно истинен, есть практическое ограничение - знание абсолютно всех причин и следствий в непрерывном мире недоступно ни человеку, ни машине. Демона Лапласа, увы, нельзя сделать членом совета директоров.

В новой парадигме стратеги-люди станут поставщиками социокультурных, экономических и политических стрессоров для организационной системы стратегического менеджмента, обусловленных их личным опытом, неполнотой знания, когнитивными искажениями и нездоровым завтраком. Они примерят на себя интригующую роль “дизайнеров неопределенности”, намеренно вносящих хаос в стратегический процесс, совершающих ошибки, провоцирующих виртуальные неудачи, из чего система DDD+AI будет извлекать полезные уроки.

Значит ли это, что IQ 80 предпочтительнее IQ 160, или тот, кто не образован, будет полезнее того, кто имеет PhD? Нет. Ошибки, о которых я пишу, с точки зрения системы DDD+AI это контрфактуалы, то есть, логические конструкции типа “А что случилось бы, если до того произошло то-то?” Они преодолевают проблему практического детерминизма, рисуя альтернативные прошлые и следующие из них альтернативные будущие, релевантные для организации. Эта релевантность и есть причина, по которой бомбардировка системы ошибками не равна забалтыванию ее произвольными глупостями.

В контексте развития организации, это похоже на биологические эволюционные процессы, где изменчивость, часто возникающая как “ошибка” в репликации генов, имеет решающее значение для адаптации и выживания в изменяющейся среде. Точно так же стратегические “ошибки” могут стимулировать организационные инновации, давая начало новым идеям и стимулируя адаптивные реакции.

Человеческая способность непрерывно совершать ошибки и при этом успешно справляться с парадоксами, двусмысленностью и иррациональностью - комбинация, которая пока сложна для AI. Будучи осознанной как новая управленческая парадигма и реализованной на практике, она может дать людям преимущество во все усложняющемся мире детерминистски взаимодействующих организаций. Неотъемлемо человеческие инструменты принятия решений - эвристики, понимание поведения других и мобилизация тацитного знания для подкрепления явного - могут существенно повлиять на повышение качества организационных стратегий.

Подход, о котором я здесь заявляю, требует организационной культуры, которая ценит ошибки - виртуальные неудачи, ценит неудачи реальные - и учится на первых и вторых. Эта культура предполагает отношение к провалу как к фундаментальному компоненту выживания и роста, а не как к осуждаемому отрицательному результату. Примечательно, что такая культурная трансформация не может произойти - во всяком случае, сегодня - без опоры на сугубо человеческие способности: эмпатию и лидерство.

Несмотря на то, что AI и DDD, кажется, вот-вот перехватят контроль над принятием стратегических решений, стратегию следует воспринимать как эволюционный процесс, (а лучше встать на позиции 3D-экстенсионализма и видеть стратегию как материальный объект), который не поддается окончательному исчислению по причине его антиэнтропийной потребности в стрессорах - ошибках и неудачах. Это хорошая новость для напуганных стратегов-человеков. Став “дизайнерами неопределенности”, этаким гормезисом для системы DDD+AI, и отбросив старую не приемлющую ошибок парадигму менеджмента, они, может быть, сумеют сохранить ценность человеческой перспективы (и свои места в советах директоров) в эпоху наступающей сингулярности.

“Как так?” и “Что ты за человек?” как главные проблемы стратегии

Философ Дэниел Деннет (Daniel Dennett) пишет, что отвечать на риторические вопросы – крайне полезное занятие. Он подразумевает, что таким образом мы освобождаем внутреннего раба, отбрасываем навязанные убеждения, чужие ценности, умерших богов. Думаю, в области морали такое - напрасный труд. Но в других областях метод, на мой взгляд, может работать.

Например, в системном стратегическом мышлении.

«Как так?» – главный риторический вопрос о неопределённости, детерминизме и свободе выбора.

Стратег не должен отмахиваться от этого забавного вздоха.

Пытаться вновь и вновь задавать его и отвечать на него означает совершенствовать системный взгляд на внешнюю среду, её уровни эмерджентности, цикличность, её очищенное от случайностей прошлое и сценарное будущее.

«Что ты за человек?» – главный риторический вопрос о ролях и акторах.

Стратег не должен избегать и этого обманчиво представляющегося банальностью вспархивания.

Задавать этот вопрос и отвечать на него значит оттачивать системное понимание бизнеса как суммы ценностных предложений, которые создаются акторами-людьми, играющими множественные роли внутри компании (внутренними стейкхолдерами), для множественных ролей в бизнес-экосистеме (внешних стейкхолдеров), которые исполняются другими акторами-людьми.

Главные проблемы стратегии, главные её вопросы – риторические.

Brute Force в стратегических сценариях

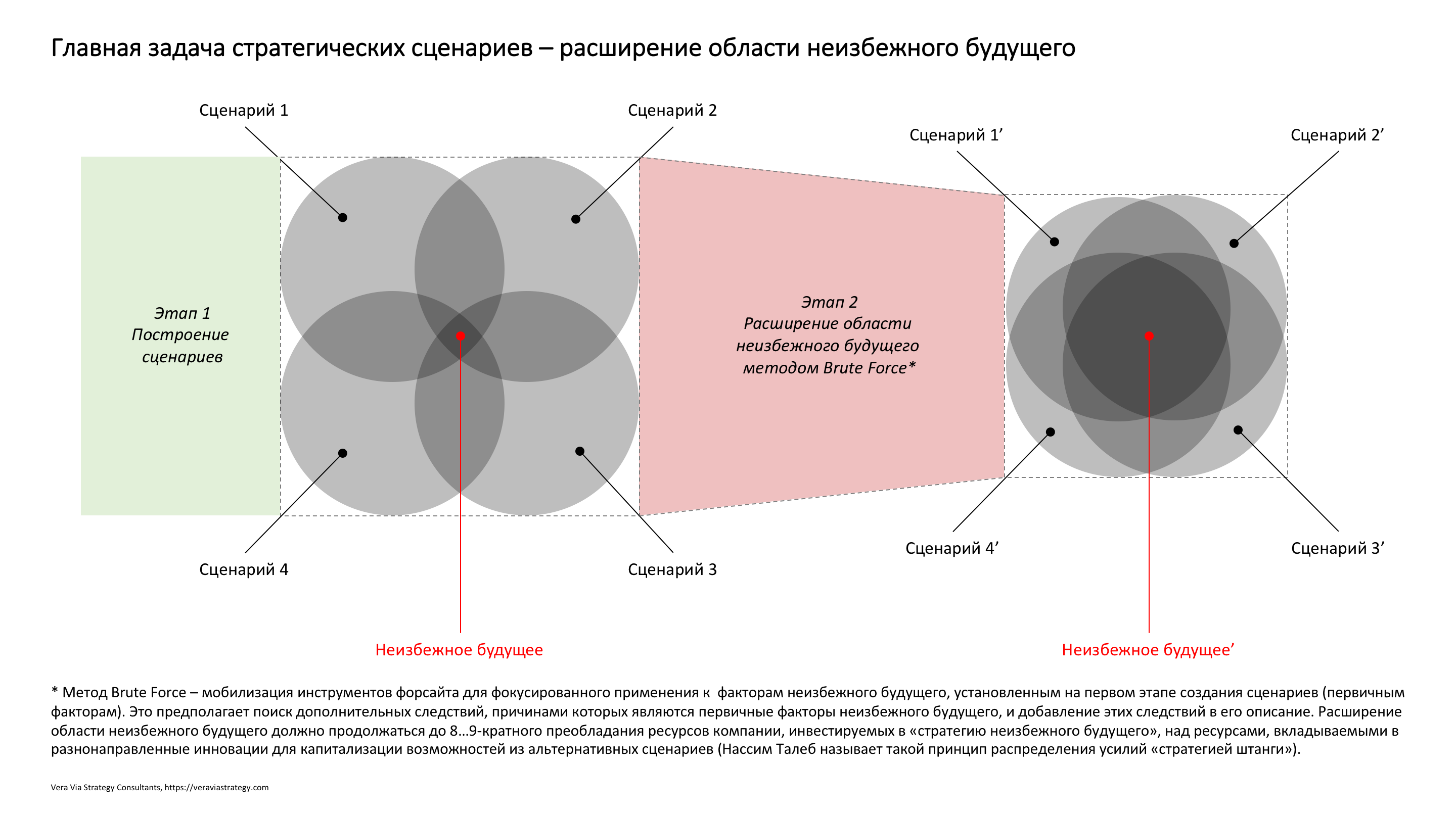

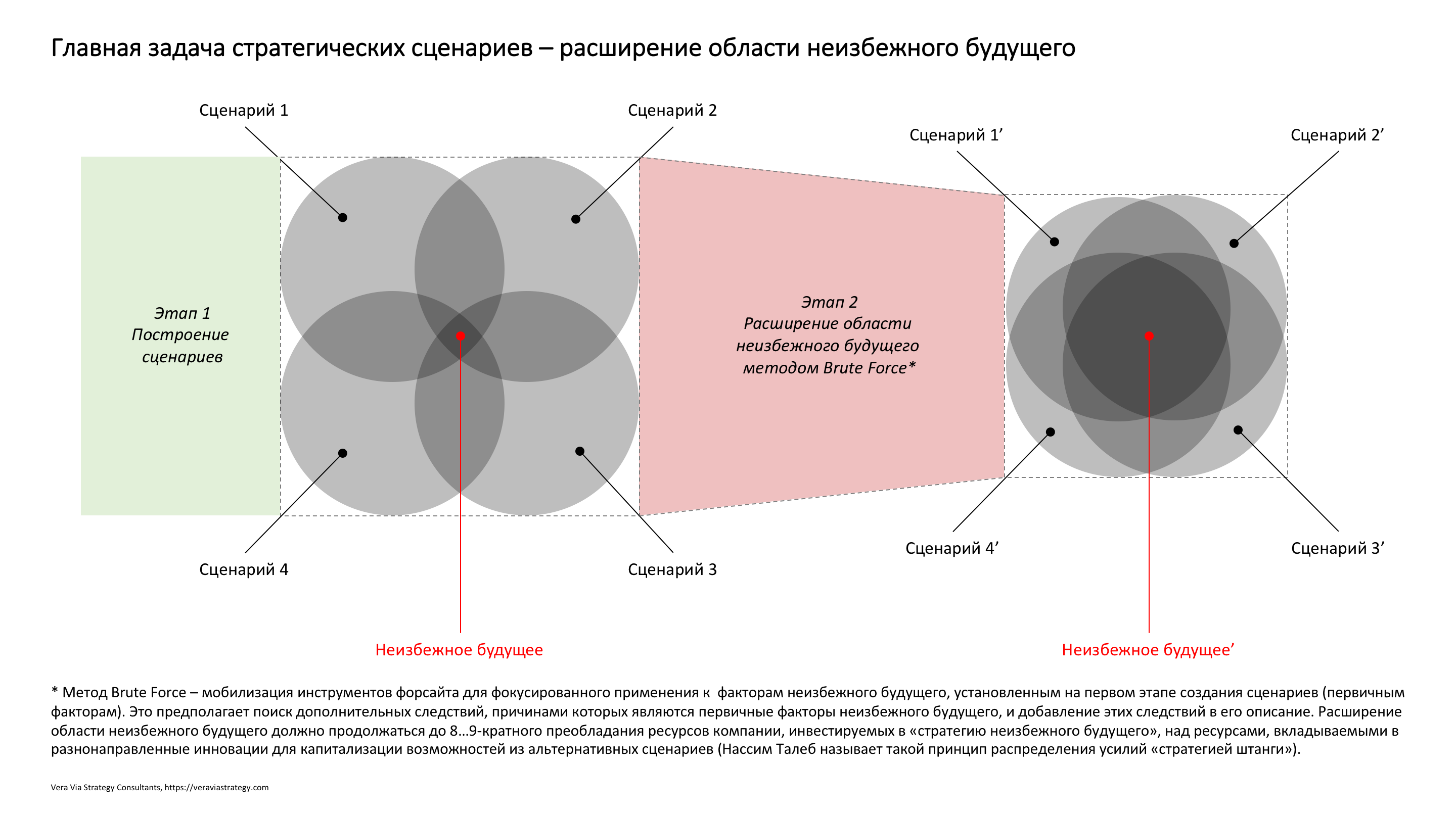

Сценарии будущего нужны в первую очередь для того, чтобы продемонстрировать нам их взаимное пересечение. На этом пересечении лежит так называемое "неизбежное будущее" - наиболее ценная находка сценарного исследования развития бизнес-экосистемы. Парадоксально, но главная цель построения сценариев - не сценарии, а детерминированная перспектива развития.

Метод Brute Force – мобилизация инструментов форсайта для фокусированного применения к факторам неизбежного будущего, установленным на первом этапе создания сценариев (первичным факторам). Это предполагает поиск дополнительных следствий, причинами которых являются первичные факторы неизбежного будущего, и добавление этих следствий в его описание. Расширение области неизбежного будущего должно продолжаться до 8…9-кратного преобладания ресурсов компании, инвестируемых в «стратегию неизбежного будущего», над ресурсами, вкладываемыми в разнонаправленные инновации для капитализации возможностей из альтернативных сценариев (Нассим Талеб называет такой принцип распределения усилий «стратегией штанги»).

Улисс

Стратегическое мышление - это моральная и интеллектуальная подготовка к тому, что что-то или даже всё пойдёт не так. В этом, вероятно, главная его ценность: стратегический замысел может рождаться (или всегда рождается) интуицией, но стратегическое мышление шлифует его в логических механизмах Системы 2. Да, логика не равна фактам, но это от неё и не требуется.

Всё, что мы делаем, мы делаем из слабой позиции, поскольку ничего не контролируем и почти не знаем детерминант непрерывной материальной среды, частью которой являемся. Со сложными задачами выживания "здесь и сейчас" справляются наши эвристики, то есть, интуитивная Система 1, работающая "компасом детерминизма" - она автоматически указывает на причины и следствия физической реальности, на уровне подсознания эффективно избавляя нас от свободы выбора. Для более протяженных во времени проблем у нас есть Система 2 - медленное абстрактное мышление homo sapiens, мышление стратега.

Секуляризм (по Веберу) или прогрессивный рационализм, как называли метод работы Системы 2 более ранние философы Просвещения, это единственный путь снижения неопределённости через поиск фактов (если повезёт) и логику, через экстенсивный сбор обоснованных выводов, доказанных причин и следствий. Это не сверкающие фонтаны разума, которых вообще не бывает, а скучный и энергоёмкий путь brute force, бесконечное приближение рационального исследователя к борхесовскому Альмутасиму - предопределенному и непрерывному миру.

Но этот же путь становится ловушкой и логическим тупиком, если соединяется в голове названного исследователя с верой (!) в свободу воли или, в более общем выражении, в случай. Рационализм может превратить Систему 2 в стратегическое продолжение Системы 1 только изгнав волю, свободу и случайность из своей онтологии.

Стратегия - это мотивирующая сказка о способе завоевания власти над частью мира, рассказываемая в будущем времени героем, желающим выжить и продолжить свой род. Речи Улисса о подробностях Троянской войны перед отплытием из Итаки.